RT-DETR v2のファインチューニングをおこなったのでメモ。

レポジトリは https://github.com/lyuwenyu/RT-DETR を参照してください。 また、本記事ではPyTorch版を前提としています。

手順

PyTorch版のREADMEを見てみるとそれほど記載がないですが、結構簡単にファインチューニングが可能になっています。

おおまかに以下の手順になります。

RT-DETR v2のファインチューニングをおこなったのでメモ。

レポジトリは https://github.com/lyuwenyu/RT-DETR を参照してください。 また、本記事ではPyTorch版を前提としています。

PyTorch版のREADMEを見てみるとそれほど記載がないですが、結構簡単にファインチューニングが可能になっています。

おおまかに以下の手順になります。

Were RNNs All We Needed?を読んだので、その内容をまとめておきます。

https://arxiv.org/abs/2410.01201

Transformerを用いたアーキテクチャの場合、推論に時系列長の二乗に比例した計算量が必要となるため、単純には非常に長い時系列データを扱うことはできません.

ちょうど一年前くらいにMambaという状態空間モデルベースの手法が提案されており、このMambaならば時系列長に比例した計算量となるため計算量的にはMambaが好ましいです.また学習も効率良くおこなえるうえ、精度的にも良い性能が得られることが分かってきており、有望な手法の1つです.

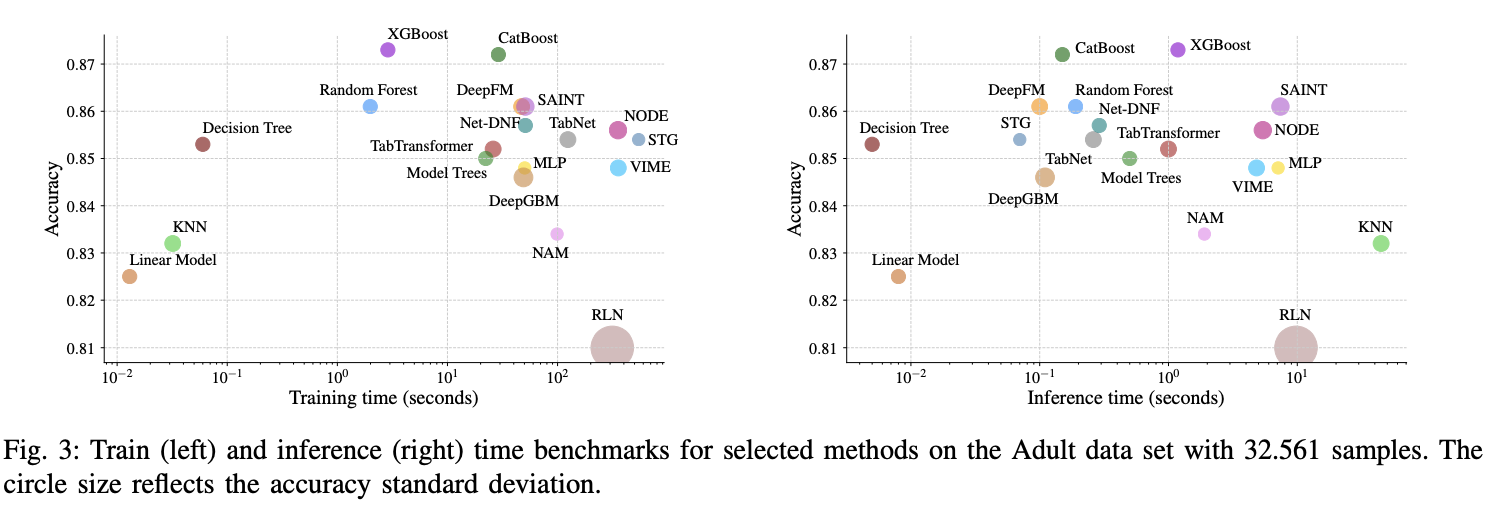

Deep Learning(DL)を用いたテーブルデータ向けの手法は色々提案されており、度々、精度面で勾配ブースティング法を超えたとか超えないと話題になる気がします。

テーブルデータ周りのDL手法に詳しくない身からすると実際のところどうなのかというのは謎だったので、サーベイ論文を読んでみました。

読んだ論文:Deep Neural Networks and Tabular Data: A Survey

YOLOv5は便利なライブラリですが、ONNXへモデルを変換したときにちょっと困ったことがあります。

というのも、変換後のONNXモデルにはNMSなどの後処理が含まれていないため、後処理は別途用意する必要があります。

公式ではPyTorchの関数を使ったNMSになっているため、そのまま後処理のコードをコピーしようとすれば実行環境上にONNX RuntimeとPyTorchの両方を用意しないといけません。でもせっかくONNXを使うなら、環境にPyTorchを入れたくないですよね。

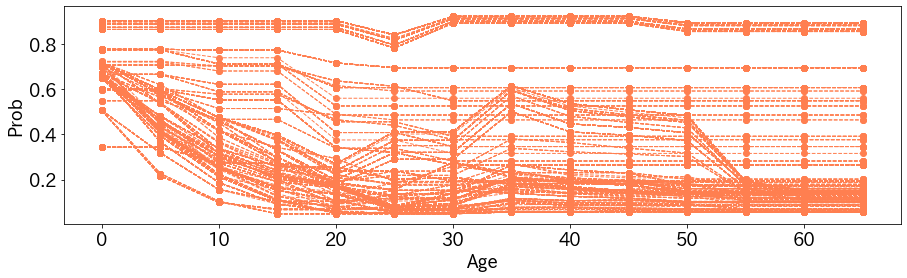

Individual Conditional Expectation(ICE)は任意のモデルのある特徴量に対するデータごとの挙動を確認する手法です。

例えば、ある特定のデータのある特徴量が大きくなるにつれ、モデルの出力がどういった変化をするかを見ます。

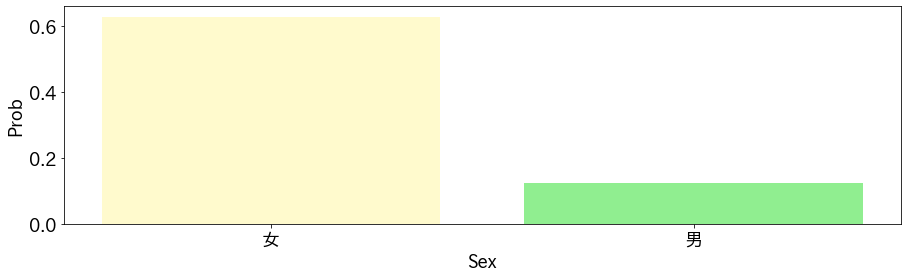

Partial Dependence Plotは任意のモデルのある特徴量に対するglobalな挙動を確認できる手法です。

例えば、特徴量が大きくなるにつれ、モデルの出力がどういった変化をするかがわかります。

本記事はQrunchからの転載です。

最近自然言語処理をよくやっていて、BERTを使うことも多いです。 BERTの性能は高く素晴らしいのですが、実際使う上では、私のような計算リソース弱者には辛いところがあります。

本記事はQrunchからの転載です。

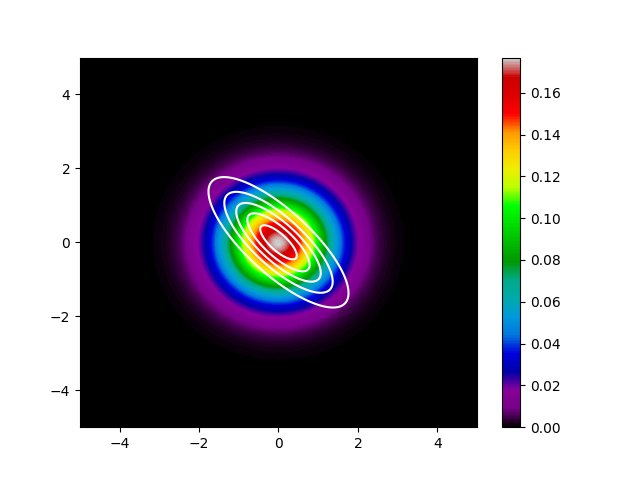

みんながよく使うKL(Kullback–Leibler) divergenceの話題です。 KL divergenceといえば2つの確率分布の違いを計算できるやつですね。 KL divergenceは対称性というものがなく、与えられた2つの分布を入れ替えるとKL divergenceの値が変わります。 今回は、この入れ替えたときの影響を最小化問題を例としてまじめに考えます。

本記事はQrunchからの転載です。

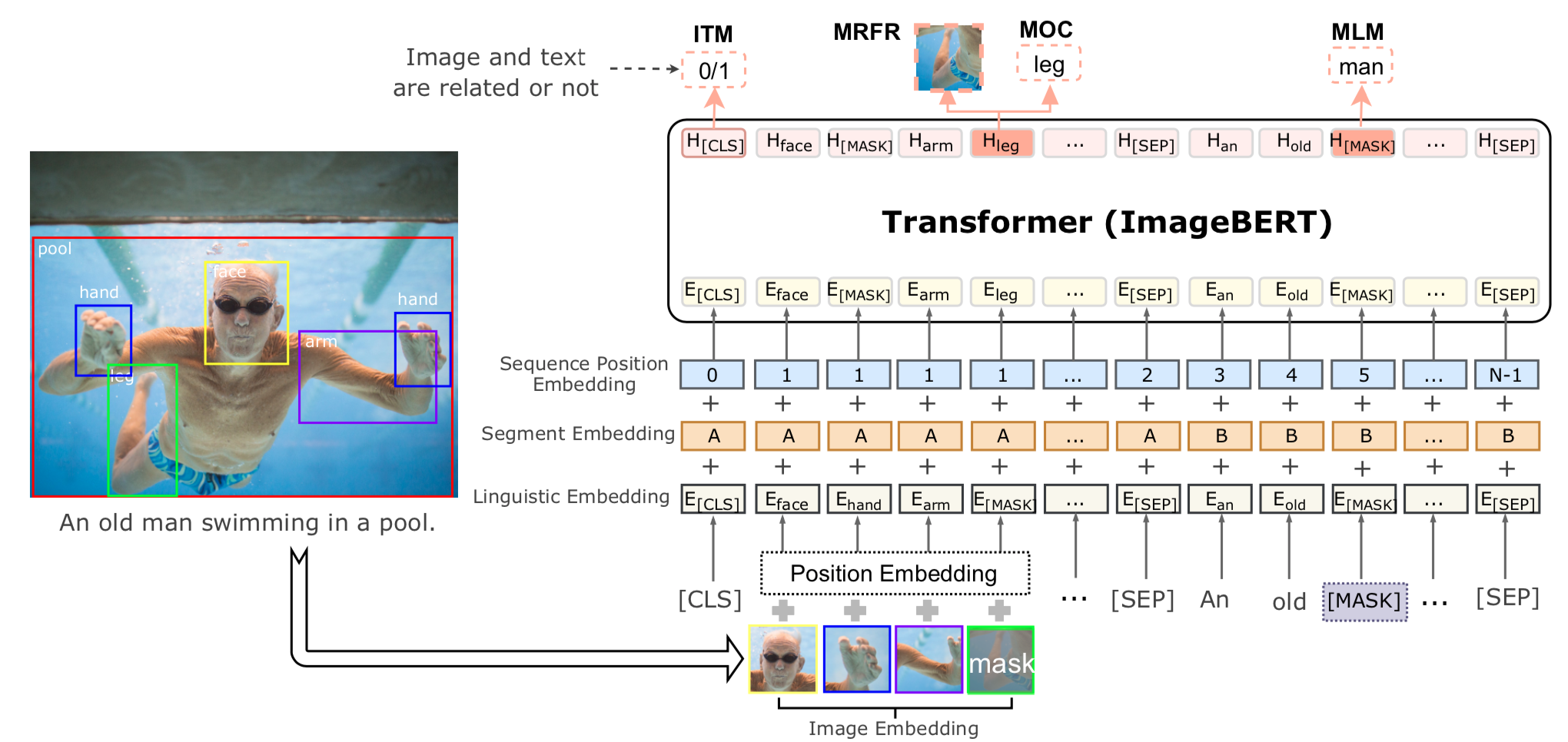

最近Microsoftから発表されたImageBERTについて紹介します。

ImageBERTはBERTの入力に自然言語だけではなく、画像も受け付けるようにしたマルチモーダルなモデルです。

また論文ではモデルのアーキテクチャだけではなく、学習方法にも新たな提案がされています。

実験ではImage-to-Sentenceでの検索とSentence-to-Imageの検索タスクでSOTAが示されています。

本記事はQrunchからの転載です。

Pandasのgroupbyについては雰囲気でやっていたところがありますので、ちょっと真面目に使い方を調べてみました。使っているPandasのバージョンは1.0.1です。