今回紹介するのは Hidden in plain sight: VLMs overlook their visual representations です.

テキストの生成というよりも画像が中心となるタスクに対し、オープンソースのVisual Language Modelの性能について調査した論文になっています. DINOやCLIPをLLMに組み込んだマルチモーダルモデルは、単体のViT系のモデルよりも性能が大きく下がることを示しています.

今回紹介するのは Hidden in plain sight: VLMs overlook their visual representations です.

テキストの生成というよりも画像が中心となるタスクに対し、オープンソースのVisual Language Modelの性能について調査した論文になっています. DINOやCLIPをLLMに組み込んだマルチモーダルモデルは、単体のViT系のモデルよりも性能が大きく下がることを示しています.

YOLO-RD (Retriever-Dictionary) は、物体検出の分野で定番となっているYOLO(You Only Look Once)シリーズの最新研究です. 今回は、ICLR2025で発表されたYOLO-RD(https://arxiv.org/abs/2410.15346)について解説します.

画像分類モデルを作っているときに予測精度をあげるのに役に立ったなぁという方法の一覧のメモです。 簡単にできるものから順に紹介しているつもりです。

本記事はQrunchからの転載です。

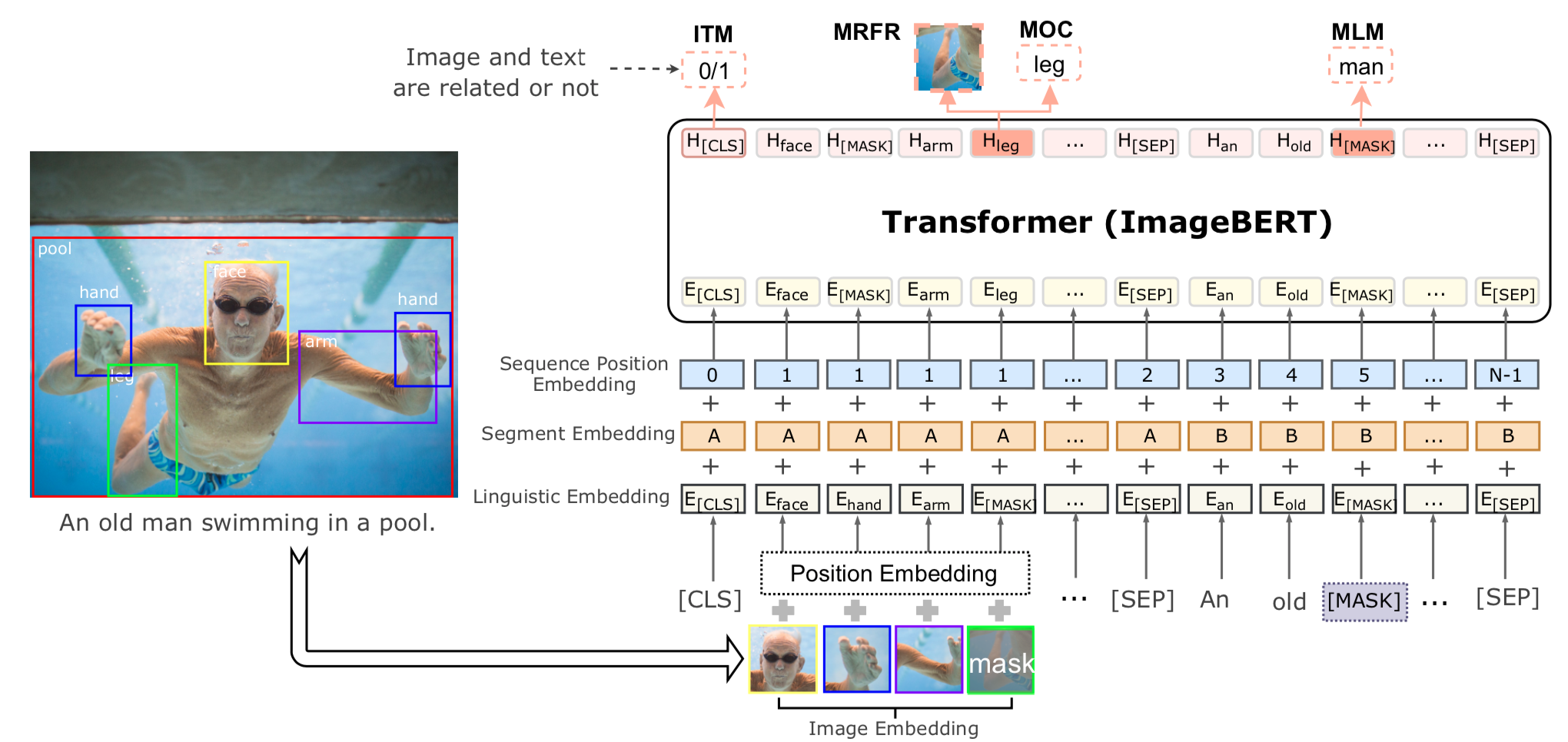

最近Microsoftから発表されたImageBERTについて紹介します。

ImageBERTはBERTの入力に自然言語だけではなく、画像も受け付けるようにしたマルチモーダルなモデルです。

また論文ではモデルのアーキテクチャだけではなく、学習方法にも新たな提案がされています。

実験ではImage-to-Sentenceでの検索とSentence-to-Imageの検索タスクでSOTAが示されています。