BERTを拡張した生成モデル?拡散型LLM「LLaDA」の概要と可能性

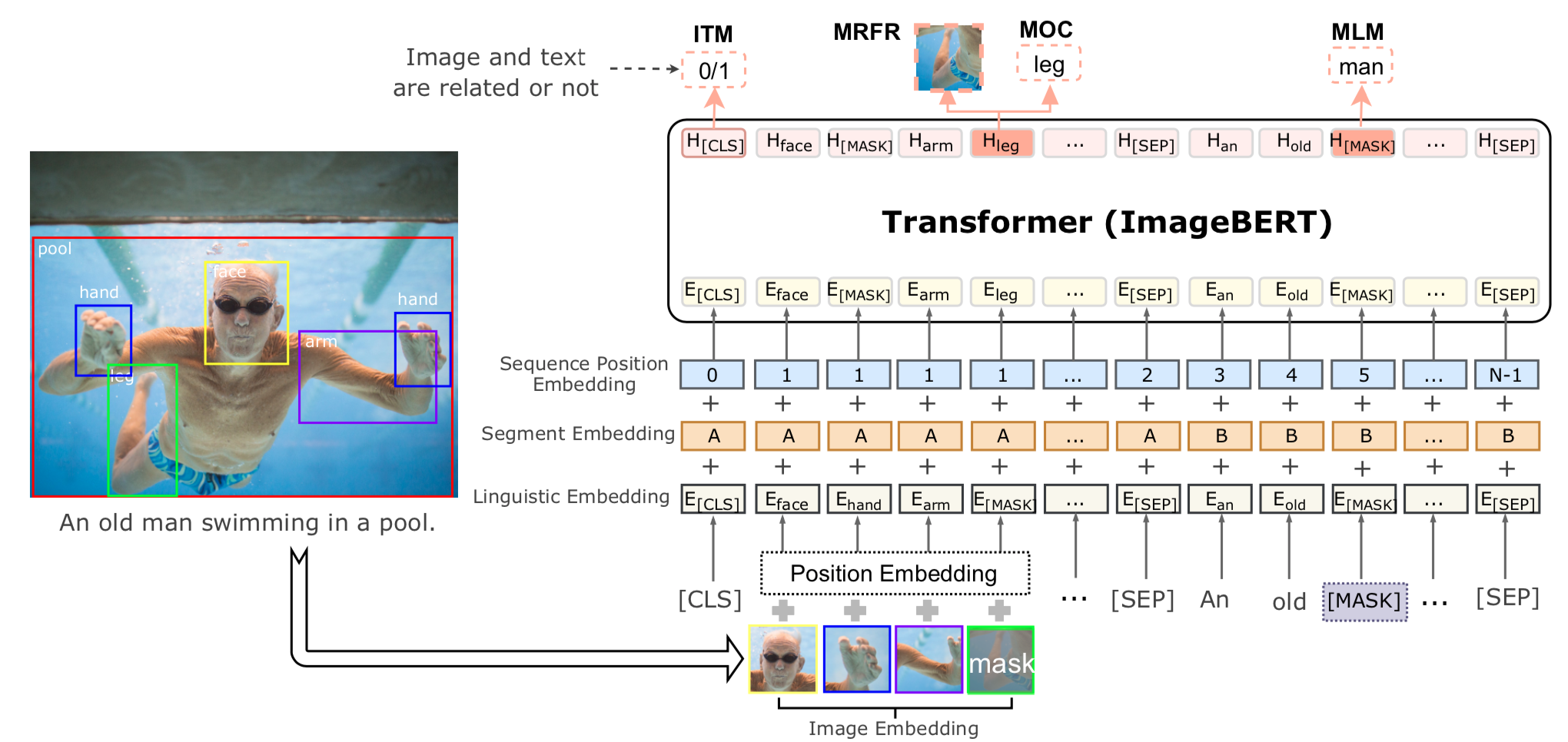

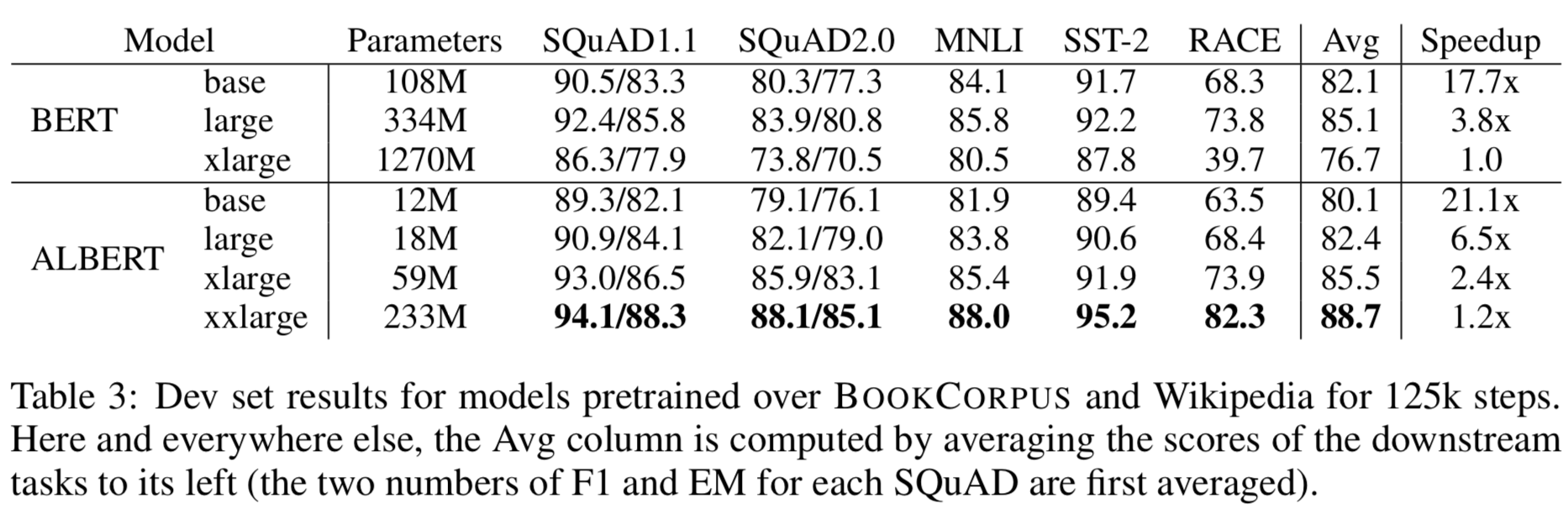

2025年に入り、拡散モデルを用いた大規模言語モデル(LLM)が注目されています.特に「Gemini Diffusion」や「LLaDA(Large Language Diffusion with mAsking)」といった新しいアプローチは、従来の自己回帰型(autoregressive)モデルとは異なる性質を持ち、今後のLLMのあり方を変える可能性すらあります. 提案手法のLLaDAとLLaMAを比較したものが以下で、提案手法は遜色ない性能が出ています.